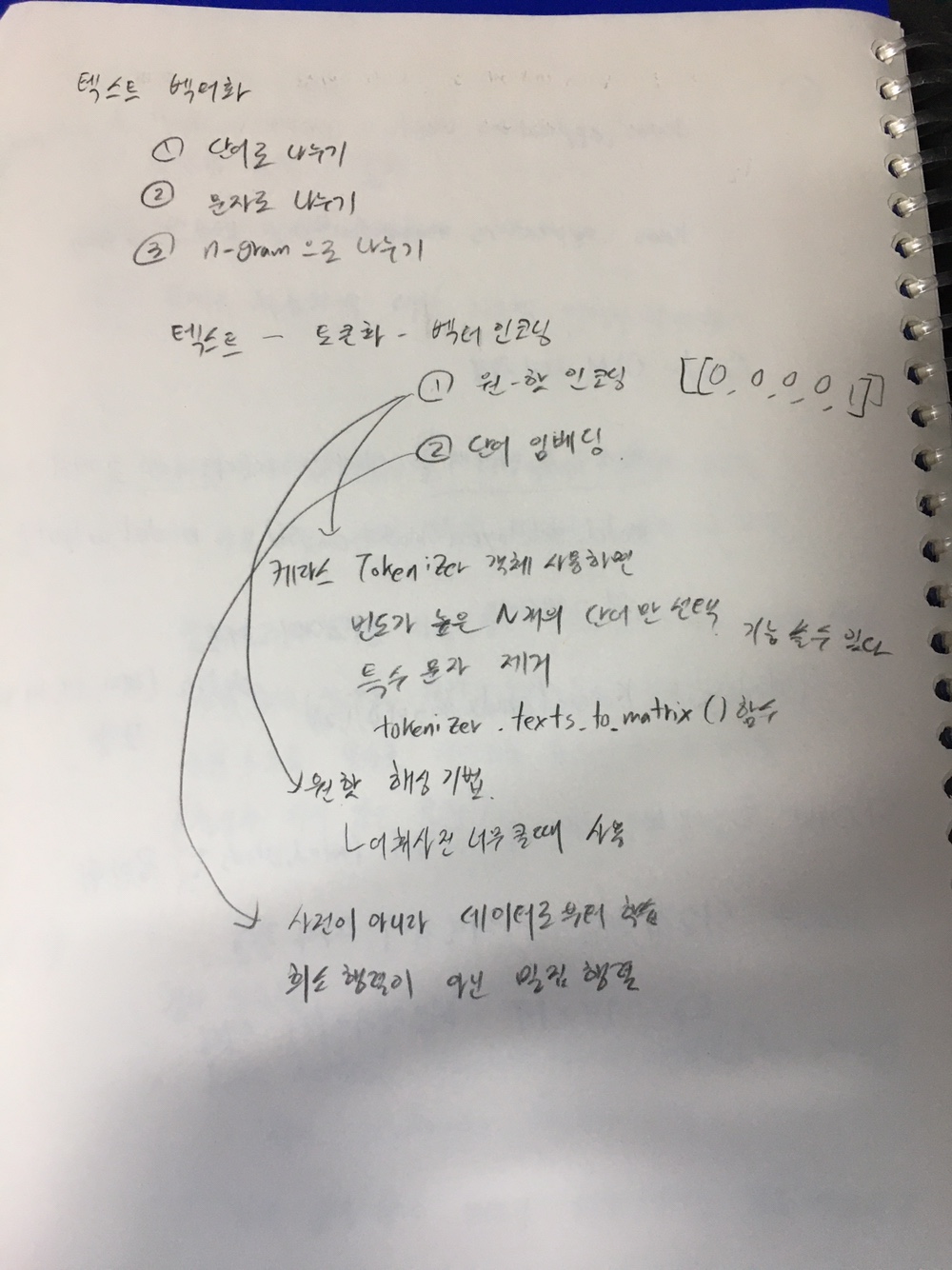

Embedding 층은 정수 인덱스 하나를 밀집 벡터로 매핑하는 딕셔너리로 이해할 수 있다.

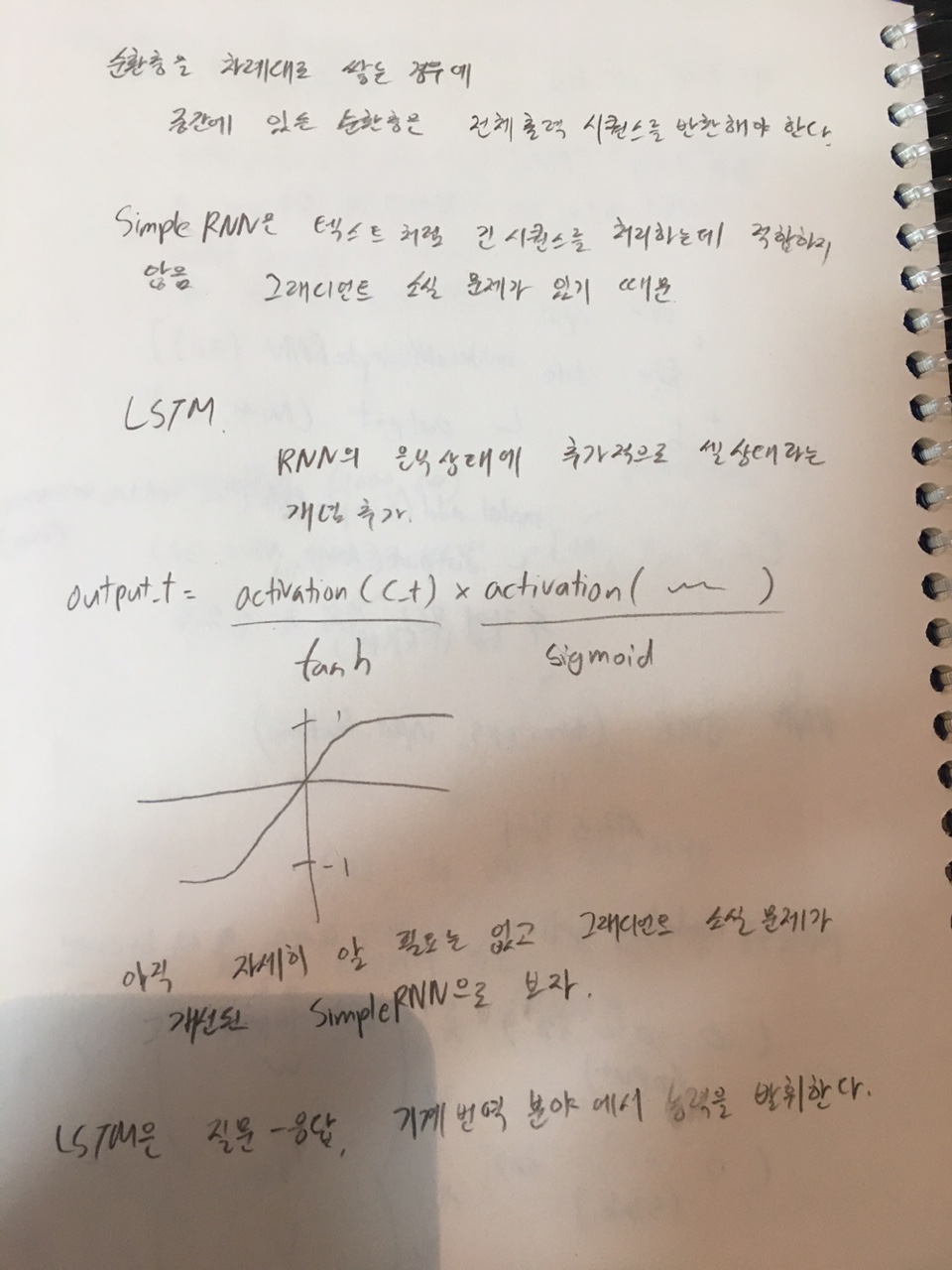

층이 많은 일반 네트워크(피드포워드 네트워크)에서 그래디언트 소실 문제가 나타나는 것과 같이 SimpleRNN에서도 비슷한 문제가 일어나기 때문에 텍스트와 같이 긴 시퀀스를 처리하는데 적합하지 않음

이런 SimpleRNN의 단점을 개선한 순환 층이 LSTM 층이다.

'읽은 책 > 케라스 창시자에게 배우는 딥러닝' 카테고리의 다른 글

| 6.4 컨브넷을 사용한 시퀀스 처리 (p.300) (0) | 2022.03.18 |

|---|---|

| 6.3 순환 신경망의 고급 사용법 (p.278) (0) | 2022.03.17 |

| 5.4 컨브넷 학습 시각화 (p.219) (0) | 2022.03.15 |

| 5.3 사전 훈련된 컨브넷 사용하기 (p.199) (0) | 2022.03.15 |

| 5.1 ~ 5.2 합성곱 신경망, 소규모 데이터셋으로 컨브넷 훈련하기 (0) | 2022.03.14 |